- 测试大神教你打造一个完美的 web 测试环境——软件测试圈

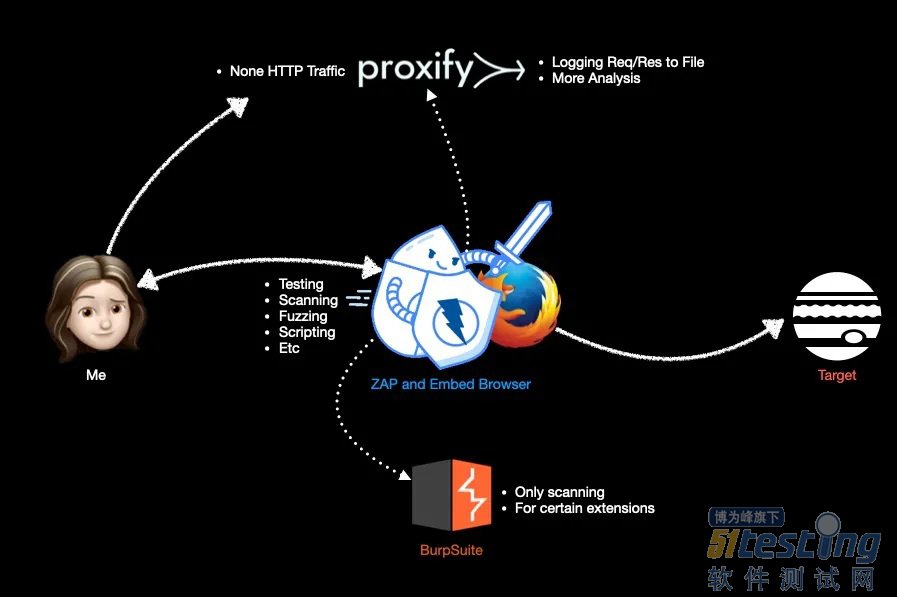

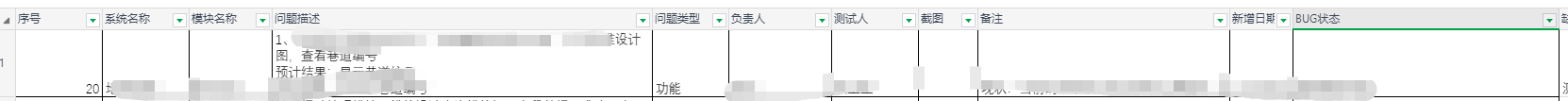

在做网站的测试时,抓包扫描必不可少,如何将测试的所有记录保存下载,待后续分析呢?先来看一个架构图:

图中的工具好像都认识,然而这些工具之间的关系是怎么样的?

我们在测试时,通常会开启一个 web 代理工具,比如 zap、burp 这些,然后设置浏览器代理为这些工具启动的代理服务,然后我们使用浏览器访问的所有网站流量都会经过这些代理工具,然后通过查看代理记录的数据包分析安全问题。

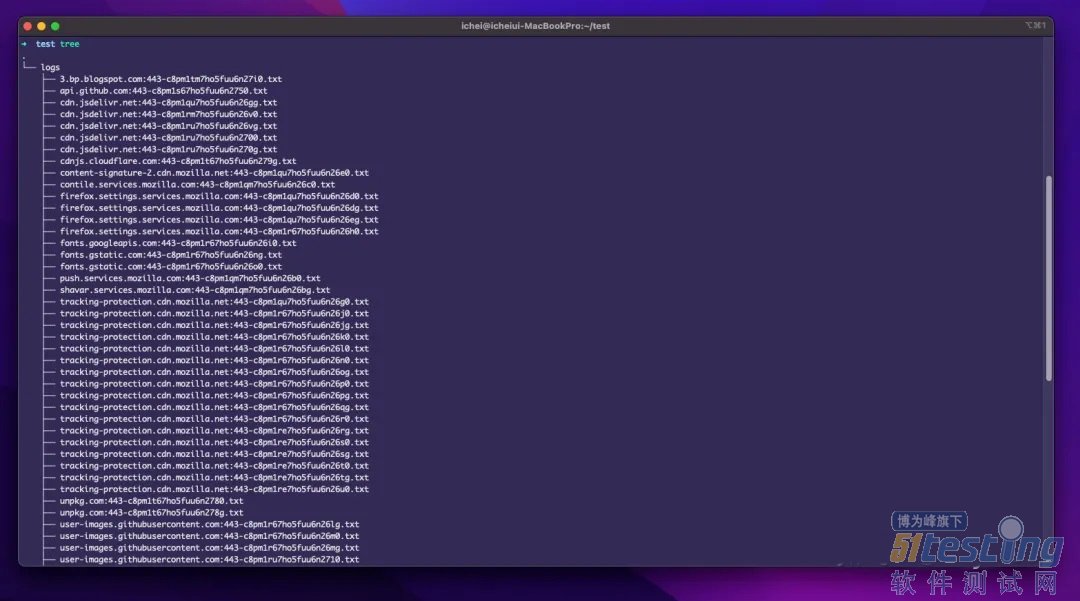

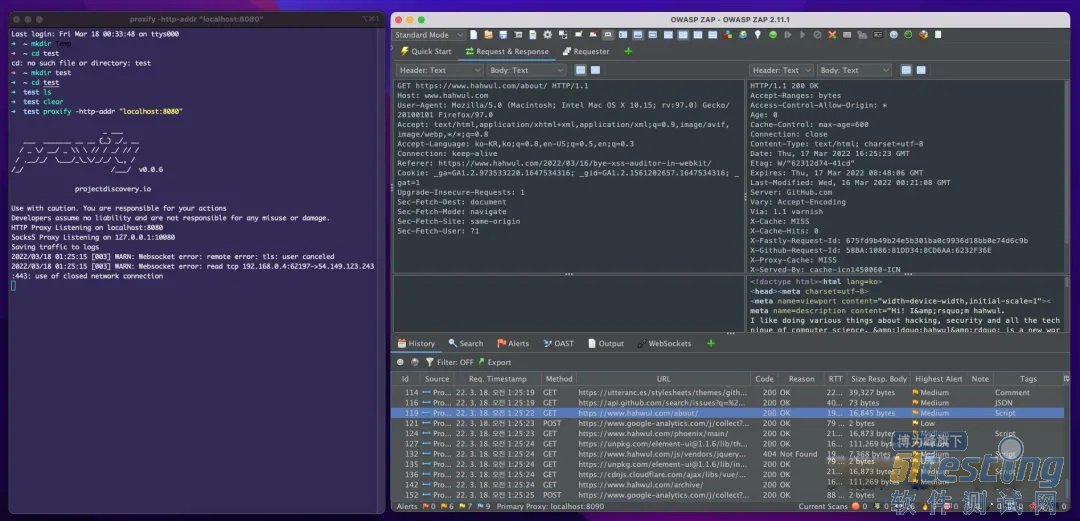

这个工具的作用与 zap、burp 类似,只不过是命令行版而非界面程序,它通用启动代理服务,浏览器设置代理之后,经过的所有流量可以进行记录保存为文件,如图:

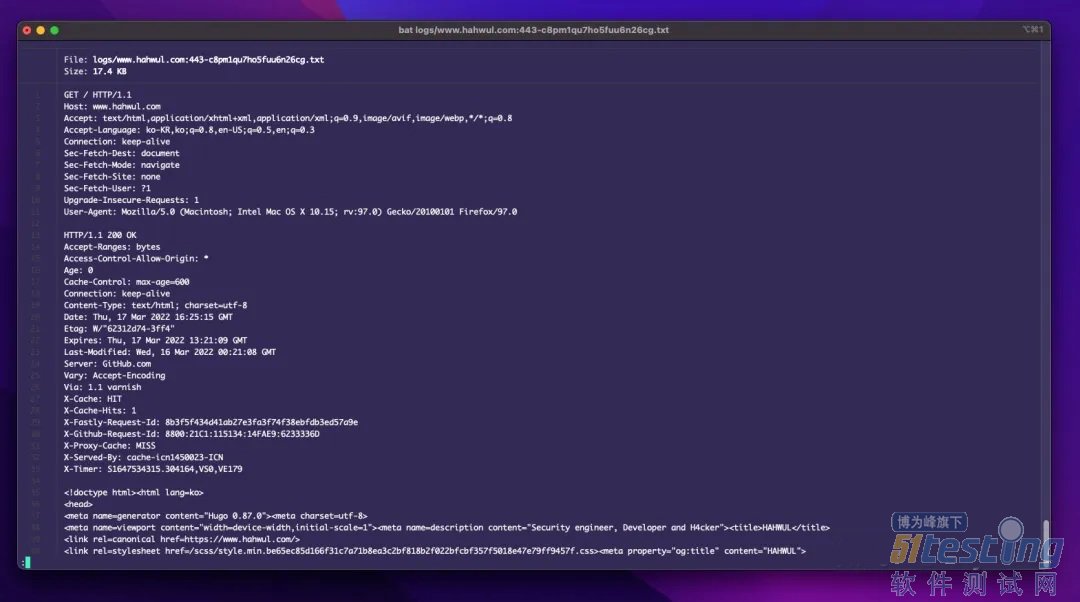

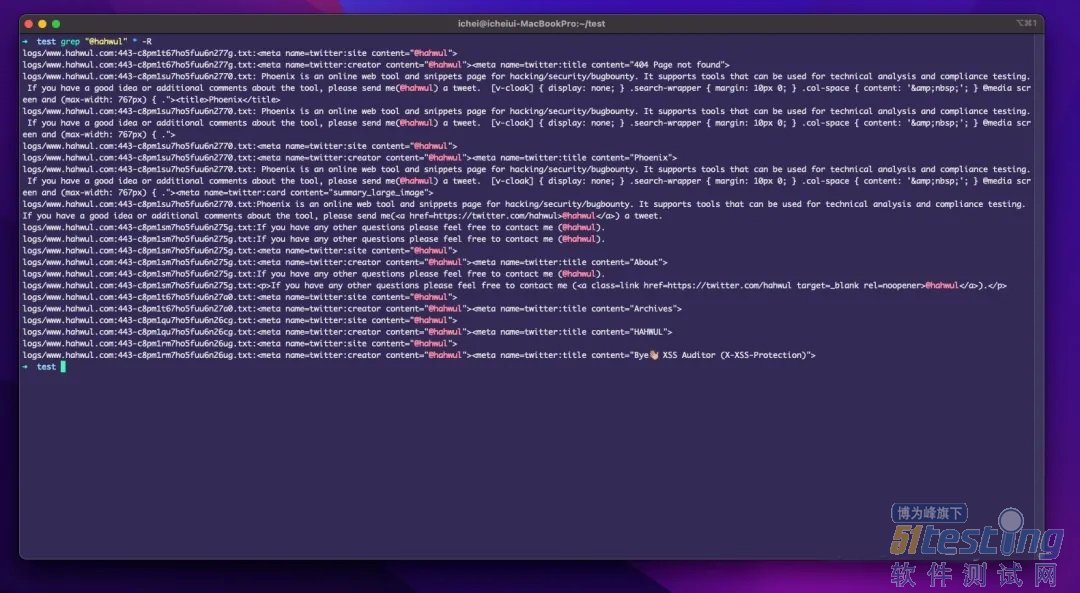

打开文件就可以看到具体请求响应内容:

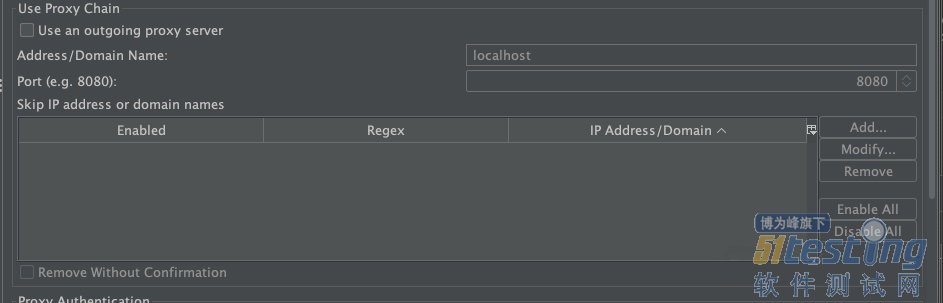

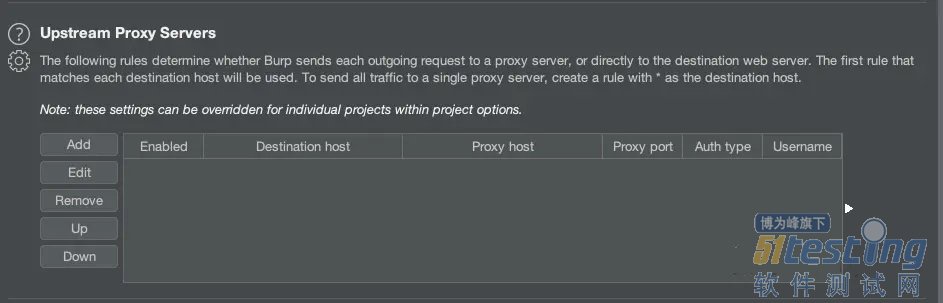

那么我们就利用它的这个功能,并且利用 zap 和 burp 都可以设置 upstram 的能力,让我们访问一次的流量,分发给不同的程序进行处理,zap:

burp:

设置好之后,通过 zap 或者 burp 的流量就会通过 proxify:

比如最开始的流程图,当我们在使用 zap+firefox 进行网站测试时,将流量同步给 burp 做漏洞扫描,然后再同步给 proxify 进行记录保存,待后续使用。

这里还可以有其他的方式,比如漏洞扫描可以使用 xray(被动漏洞扫描器),而人工触发漏洞扫描,可以使用 crawlergo(基于浏览器内核的爬虫) 代替,项目地址:https://github.com/Qianlitp/crawlergo

比如,使用 grep 查找字符串:

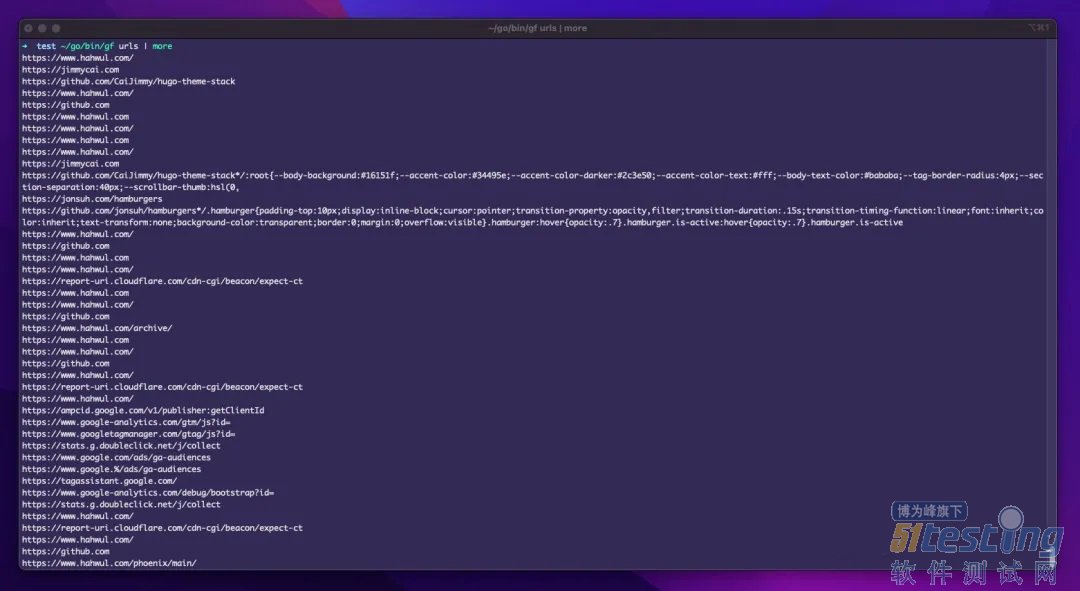

查找所有内容中的 URL,使用命令行工具 gf:

以上就是本文的内容,工具都有它的特性,相互结合可以大大提升测试效率,那么你的 web 测试环境是什么样的?

作者:myh0st

- -1.00 查看剩余0%

- 【留下美好印记】赞赏支持

登录 后发表评论

温馨提示

- 推荐阅读

- 换一换

- Django项目Windows启动优化08-02项目场景: 楼主的项目使用Django应用框架,一般的Django项目,启动一般有三个步骤1.启动runserver :python manage.py runserver2.启动celery:python manage.py celeryd -l info3.启动celerybeat:python manage.py celerybeat -l info 如果在linux服务器上,我们可以设计一个....

- 基于python的开放平台签名、认证体系测试探索05-06摘要当前大型top企业都有非常成熟的开放平台业务,比如微信开放平台、新浪微博开放平台、支付宝开放平台等。开放平台的发展为第三方个人或企业提供了巨大的机遇。开发者想要接入各大开放平台,必须要遵从开放平台的安全机制,实现业务逻辑的前提,首先就是要实现签名验签、加密解密以及授权认证机制。本文介绍基于python的开放平台签名、认证测试体系,可以用于第三方应用的沙盒测试,同时可以应用于服务提供方相关系统的全面测试。一、引言开放平台是指大型企业将自身的数据能力、计算能力、用户体系、产品能力等资源以业务+场景+解决方案+技术的优势包装出来,通过openAPI、openSDK、openH5等形式开放给第三方...

- 软件测试的类型-其他类型的测试(3)08-01比较测试将产品与之前版本或其他类似产品的优缺点进行比较称为比较测试。等价划分它是一种测试技术,也是黑盒测试的一种。在此 等价分区期间,会选择一组组并选取一些值或数字进行测试。可以理解,来自该组的所有值都生成相同的输出。此测试的目的是删除特定组中产生相同输出但没有任何缺陷的冗余测试用例。假设应用程序接受 -10 和 +10 之间的值,然后使用等价分区,选择用于测试的值是零、一个正值和一个负值。因此,此测试的等效分区是 -10 到 -1、0 和 1 到 10。示例测试示例测试是实时测试。它包括实时场景和基于测试人员经验的场景。这种类型的测试也被称为基于经验的测试,因为它使用测试人员对应用...

- 一 现状及场景 1、缺失bug根因分析环节 工作10年,虽然不是一线城市,也经历过几家公司,规模大的、规模小的都有,针对于测试行业很少有Bug根因环节,主流程基本上都是测试提交bug-开发修改-测试验证-发送报告,测试环节结束。 往往有下面几个原因: · 时间压力: 在项目开发周期紧张的情况下,测试团队可能会因时间压力而忽略深入的BUG根源分析。解决方案:合理规划测试时间,将足够的时间用于分析和解决问题。 · 技能和经验不足: 一些测试人员可能缺乏足够的技能和经验来进行深入的BUG根源分析。解决方案:提供培训和指导,提升团队成员的技能水平。 · 沟通不畅: ...

-

- 岁月是把杀猪刀,悄咪咪地架在我们的脖子上。我们这些别人眼中的“老司机”,一直行走在IT行业的测试老鸟,已经/正在/即将踏上35岁的尴尬年龄,面临前有强敌,后有追兵的复杂境况,真是各种为难。 所以,你身边35岁以上的测试员,现在都在干嘛? 面对这样的灵魂拷问,总是有人欢喜有人忧……来看看他们的答案,找到自己要走的路! @享受现在 “25和35有区别吗?反正你都得拼了命的找bug,除了赚钱请别跟我谈别的” @曾经的王者,现在的青铜 “作为高考精英进入了测试这一行,让我有了很强的优越感。然而 IT行业日趋迅猛,长江后浪推前浪,35岁的测试员如果想凭学历和经验站稳脚跟不太现实,技术更新...

-

温馨提示

打开微信 扫一扫

温馨提示

设置支付密码

- 关于我们 联系我们 版权声明 广告服务 站长统计

- 建议使用IE 11.0以上浏览器,800×600以上分辨率,法律顾问:上海兰迪律师事务所 项棋律师

- 版权所有 上海博为峰软件技术股份有限公司 Copyright©51testing.com 2003-2024, 沪ICP备05003035号

- 投诉及意见反馈:webmaster@51testing.com; 业务联系:service@51testing.com021-64471599-8017

- 51testing软件测试圈微信